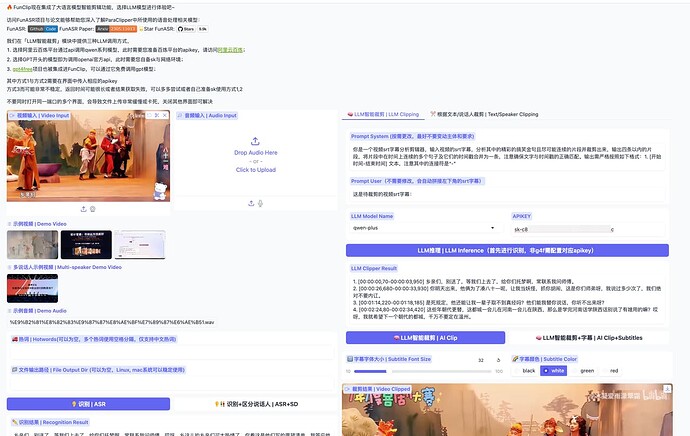

FunClip是一款完全开源、本地部署的自动化视频剪辑工具,通过调用开源的FunASR Paraformer系列模型进行视频的语音识别,随后用户可以自由选择识别结果中的文本片段或说话人,点击裁剪按钮即可获取对应片段的视频

安装FunClip

- 打开应用商店,找到FunClip,即可一键安装部署FunClip

使用FunClip

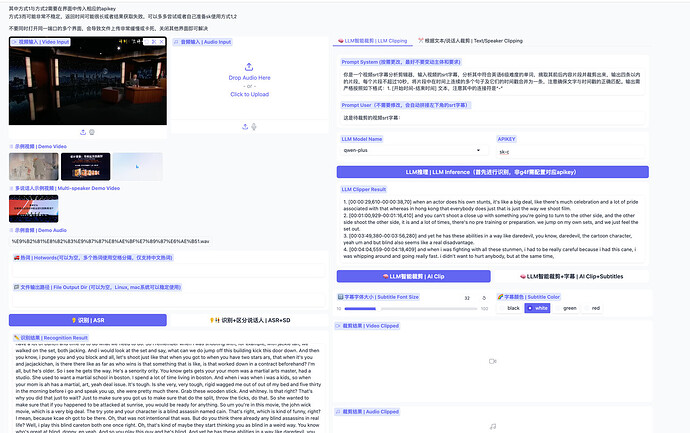

进行视频或音频的文字识别ASR

你可以使用FunClip进行视频或音频的语音转文字,支持按角色和时间轴输出字幕文件。

注意

- 目前支持中文和英文语音识别,暂不支持其他语言。支持中文中少量夹杂英文,但不保证效果。

- 默认使用中文语音识别,如需识别英文,请参照下文切换语言部分修改配置参数

- 视频和音频文件大小应控制在80Mb以下,否则可能因文件过大而无法处理

- 请勿反复刷新页面,同时打开多个页面,或者在一个任务未完成时点击按钮进行其他操作,FunClip有可能因此工作异常。如果遇到FunClip异常,您可以通过重启程序来尝试恢复。

- 因为视频和音频文件的格式、编码格式、码率等参数上的差异,可能导致FunClip在处理某些文件时会出现异常,包括但不限于报错、无法识别文字等问题。目前暂无明确的有效性检查,只能尝试性使用。

-

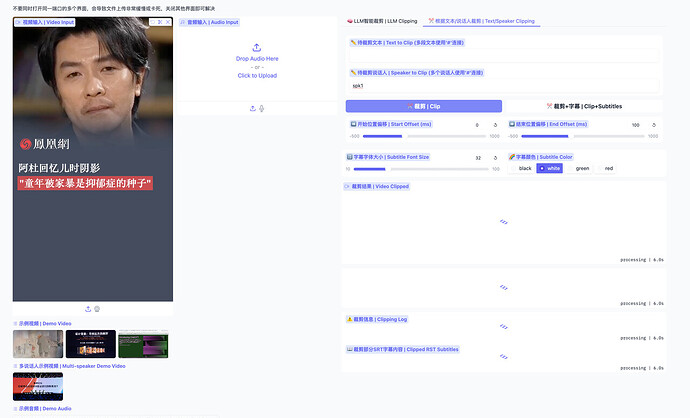

打开FunClip页面,上传视频或音频

-

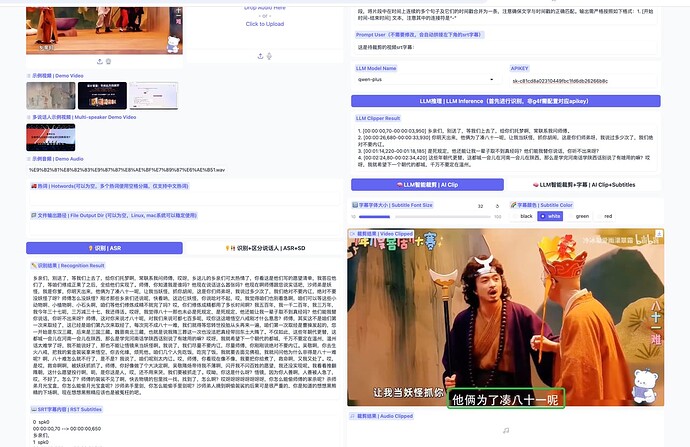

点击左侧下方的 识别 或者 识别+区分说话人即可生成语音转文字内容和SRT字幕内容

-

在成功识别字幕文件后,您还可以使用右侧的智能剪辑功能对视频进行智能剪辑。

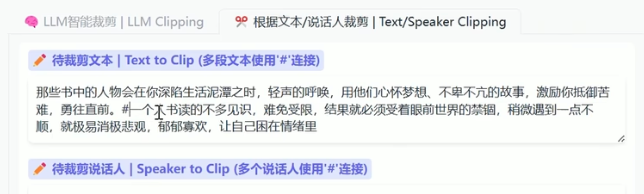

根据文本/说话人裁剪

-

可以从识别的文字中复制粘贴一段内容到 代裁剪文本 中,点击裁剪可裁剪出对应的视频或音频片段。如果需要多段文本,可以用

#连接。

-

使用识别+区分说话人进行语言识别后,可以选择将多人对话中某一个人内容全部剪出来。例如提取播客音频中某位嘉宾的观点等

- 在待裁剪说话人处,输入左侧 SRT字幕内容 中说话人的标识,如

spk1即可。如果需要剪辑多个人的说话视频,可以在多个说话人之间用#连接,如spk1#spk2。可以在下方设置偏移量来修改每句话前后要剪进来的内容。

- 在待裁剪说话人处,输入左侧 SRT字幕内容 中说话人的标识,如

-

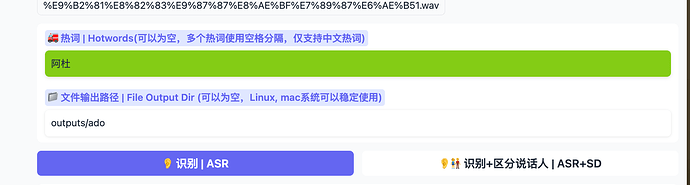

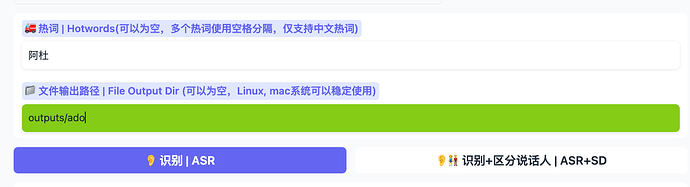

如果视频中包含一些特定的专有名词,可以在填入热词处,提高识别准确度

-

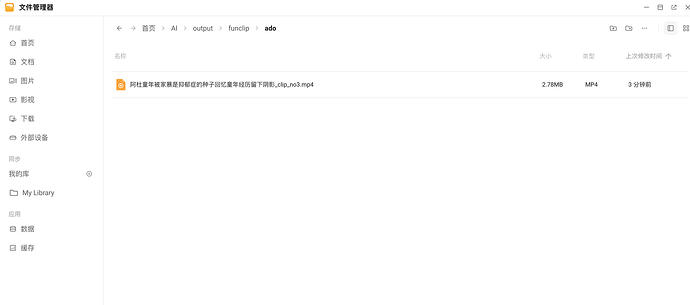

可以在左侧配置文件输出路径,必需以

outputs开头。可以加上子文件夹路径,例如outputs/ado。这样剪辑好的视频会自动保存到 用户文件夹首页目录下的AI/output/funclip/ado文件夹中

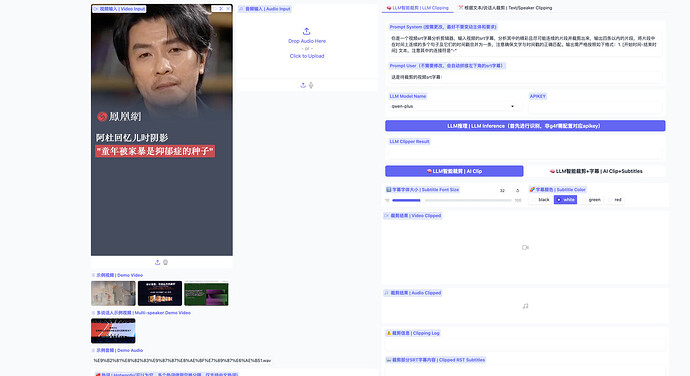

使用LLM智能剪辑

-

可以利用LLM对字幕文件进行分析,然后按要求进行剪辑。例如剪辑脱口秀中的爆笑金句片段,直播片段的高转化口播,筛选英文对话中不同水平等级的词汇等。

-

完成语言识别后,在API-KEY处配置对应模型的API,点击LLM推理筛选需要剪辑的片段时间轴。你可以在LLM Clipper Result处预览LLM挑选的切片内容。你可以手动修改前面的时间轴。

注意:

- FunClip不做后端存储,每次刷新页面后需要重新填入API-KEY

- WebUI上只支持Qwen和OpenAI的模型供应商,且只能选列表中列出的模型

-

剪辑视频。点击下面的LLM智能裁剪就会按Clipper Result里的时间轴裁剪原视频并合成一段新视频。如果选择,LLM智能裁剪+字幕则会直接在视频上嵌入硬字幕。

字幕时间轴有时候可能不准确,使用时请注意核对。目前WebUI上暂无手工编辑嵌入字幕的功能。

-

要识别英文语音或视频,需要先参照下文切换识别语言部分修改配置参数

- 操作步骤和中文视频识别一致,提示词建议仍然保持中文

- 操作步骤和中文视频识别一致,提示词建议仍然保持中文

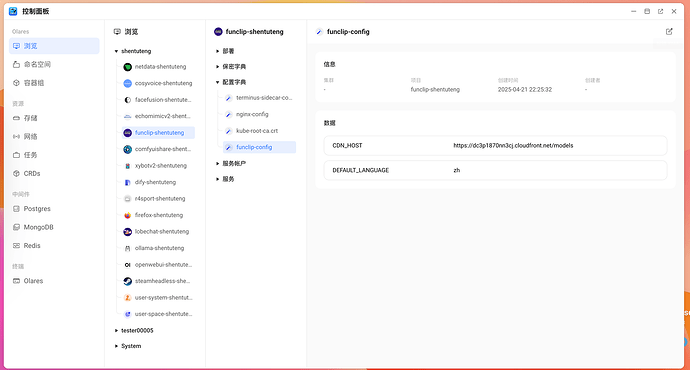

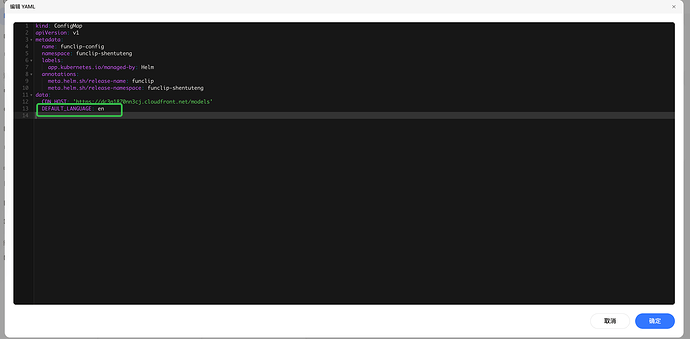

切换识别语言

FunClip目前提供中文和英文的语音识别。默认使用中文,如需识别英文视频或音频,您需要切换启动语言参数为en。具体步骤如下:

- 打开控制面板,找到 funclip ,打开配置字典

funclip-config。将DEFAULT_LANGUAGE的值改为- 英文:

en - 中文:

zh

- 英文:

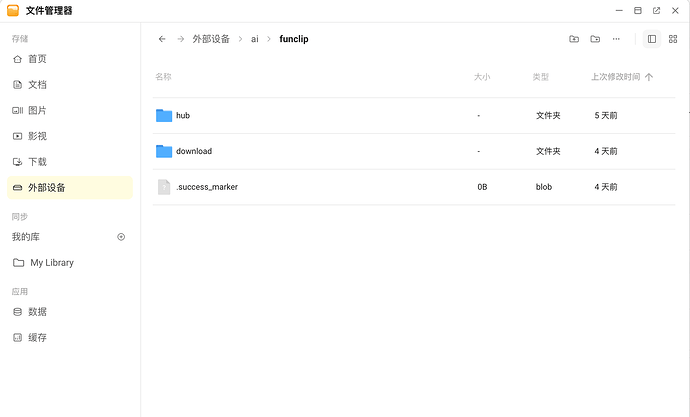

卸载FunClip

要完全移除FunClip以及所有相关的模型数据,您需要

-

应用商店卸载 FunClip

-

删除模型文件:进入 文件管理器 > 外部设备 > ai 目录下删除funclip目录和里面的所有内容