EchoMimicV2 可以利用参考图像、音频片段和一系列手势来生成高质量的动画视频,确保音频内容与半身动作的连贯性。

安装EchoMimicV2

-

打开应用商店,找到EchoMimicV2,即可一键安装部署EchoMimicV2

首次安装时,EchoMimicV2需要先下载必需的模型文件(大约20GB)。这一安装过程耗时会因为您的网速而有较大差异,请你耐心等待安装完成

-

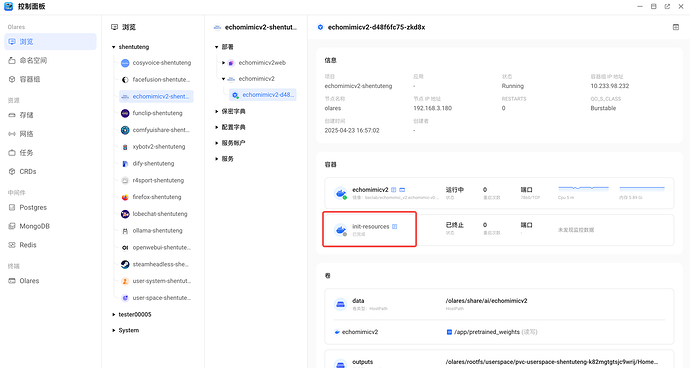

如果长时间安装未完成,您可以打开 控制面板,找到 echomimicv2 ,查看部署下面的init-resources容器是否运行正常。如果像下图所示,容器显示为已完成,则表明模型下载工作已完成。

-

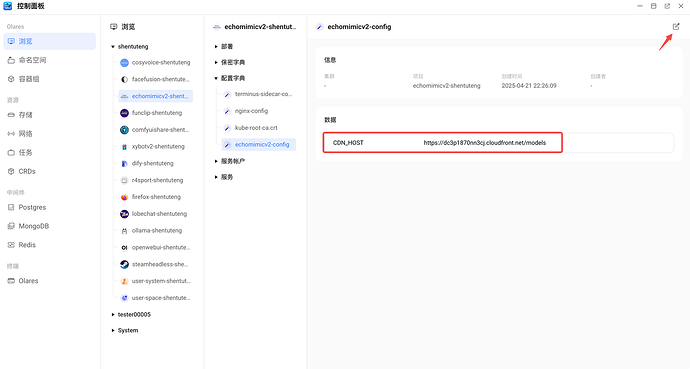

如果下载速度过慢或多次下载失败,可能是您和模型下载cdn服务器之间网络不畅导致的。您可以打开控制面板,找到

echomimicv2,打开配置字典echomimicv2-config。国内用户可以点击右上角的编辑按钮,将CDN_HOST 的值改为https://cdn.joinolares.cn/models,然后按上一步方法重启容器。

基于图像、音频合成数字人视频

注意:

- EchoMimicV2的视频生成速度极慢,在4060Ti 的显卡上,5秒的视频需要30-50分钟。请在开始生成后耐心等待。

- 目前使用默认的手势序列只能生成至多13s的视频。

- 自定义手势序列目前无法通过UI简单实现,有需要的朋友可以参考demo.ipynb中的手势提取代码制作。本教程不展开介绍。

-

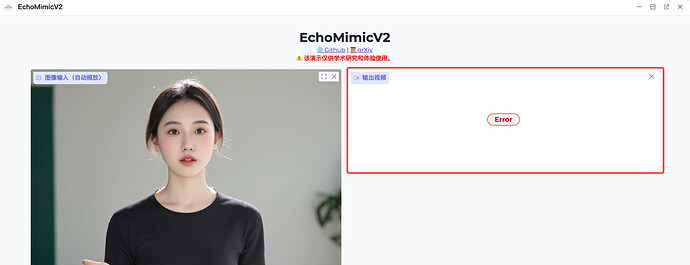

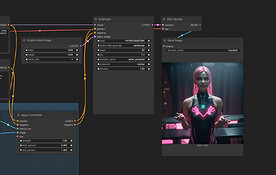

打开EchoMimicV2,上传参考图片。EchoMimicV2对参考图片的要求非常高,请参照“准备自己的人物形象”部分制作符合要求的参考图片。建议先选择下方的预设人物熟悉操作。

-

音频输入部分拖入自己的音频素材,建议使用wav或mp3格式,时长不要超过10秒。你可以点击右下角的剪刀按钮剪辑音频。

-

大部分参数都不用修改。视频长度/帧率就是视频时长,例如24的帧率,120时长就是5秒的视频长度。可以适当调整cfg参数,调整范围为1.5-3.0,CFG越低,视频质量越好,但是嘴型效果越差。CFG越高,视频质量越差,但是嘴型效果越好。Int8可以视情况开启。

-

点击生成视频即可开始生成视频。生成速度极慢,请耐心等待。在视频生成中,你可以关闭webui,程序仍然在运行,请勿在视频生成完成前重复发送生成任务。

-

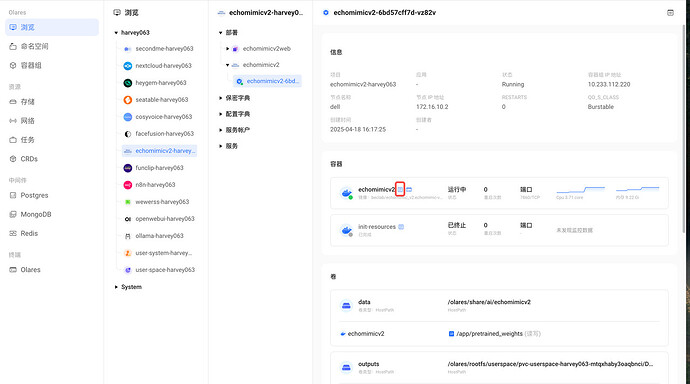

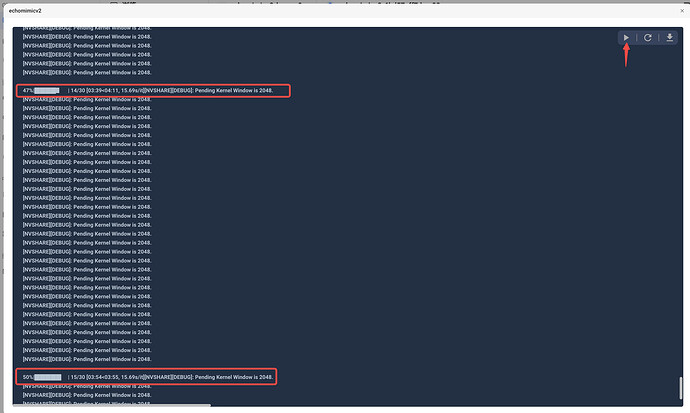

如果关闭了WebUI,你可以打开控制面板,找到echomimicv2,打开日志,点击右上角查看实时日志查看任务进度。

-

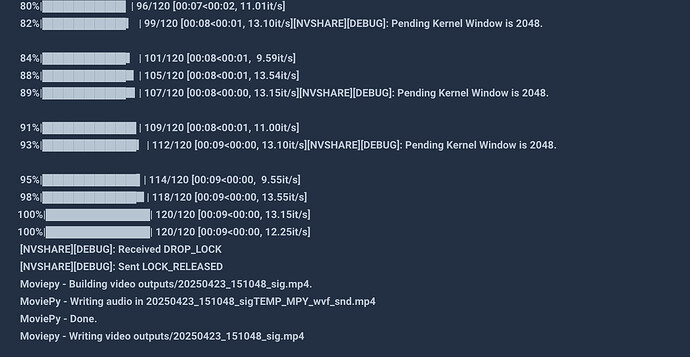

如果WebUI上出现 Error 请不要立即重试任务,这可能是后端在渲染视频长时间无响应导致的。此时可以用前一步的方法打开echomimicv2的日志查看有没有报错信息,如果没有则任务可能仍在进行。当看到如下日志内容时,表明视频已生成完毕

-

-

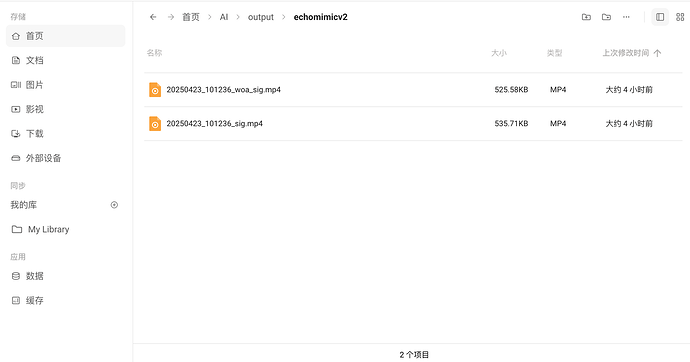

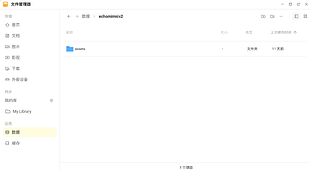

生成完毕的视频可以在

首页 > AI > outpu > echomimicv2中看到,其中带woa的是不含音频的视频文件,另一个是包含了音频的视频文件

准备自己的人物形象

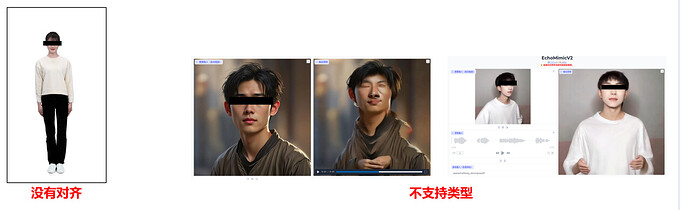

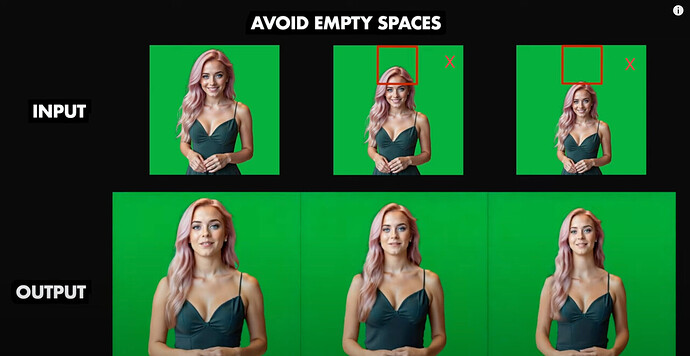

EchoMimicV2对于参考图片的人物朝向、景别、光源、画面比例等都有非常高的要求,必需严格按照官方提供的示例制作参考图,否则生成的视频将有各种形变、异常。推荐的做法是使用图生图模型,将官方的参考图像转绘成您自己的数字人形象。

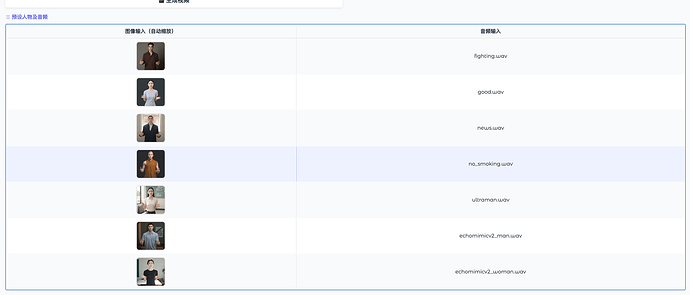

- 官方参考图示例:

- 其他注意事项请参考以下链接中的文字说明和介绍视频:EchoMimicV2常见问题汇总 · antgroup/echomimic_v2 · Discussion #40 · GitHub

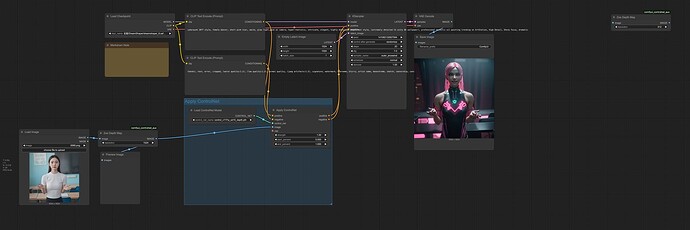

你可以参考以下方式用ComfyUI生成自己的参考人物图片

-

从官方参考图示例中挑选合适的图片作为控制图

-

打开 ComfyUI 共享版 的启动器程序

-

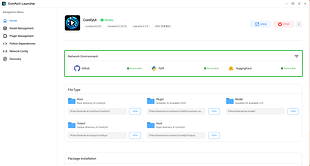

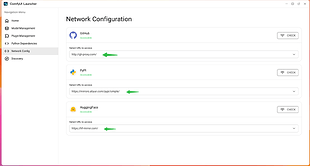

在首页检查三个网络环境是否都畅通。如果都显示可访问,则启动ComfyUI。

- 如果不畅通需要打开网络配置页修改网站的访问地址,后续的workflow节点可能会自动去下载缺失的模型

- 如果不畅通需要打开网络配置页修改网站的访问地址,后续的workflow节点可能会自动去下载缺失的模型

-

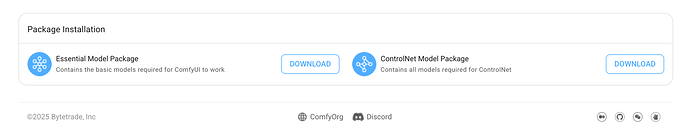

工作流中需要安装首页底部的必备模型包和ControlNet模型包,如果没有安装请先安装

-

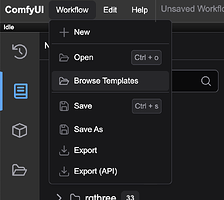

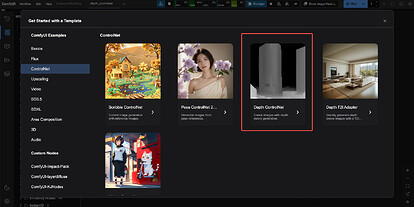

编辑参考图生成工作流。打开ComfyUI界面,点击Workflow > Browse Template,找到ControlNet标签,选择Depth ControlNet

注意:生成图片的工作流并不唯一,此处仅展示一种实现方式。你可以在此基础上改进,例如增加人物蒙版做精细扣像生成绿幕参考图。或是使用其他工作流,例如进行人物换脸等。

你也可以直接下载本案例的工作流,省去自己配置的流程(在ComfyUI中导入下图即可导入工作流)。

建议您尽量跟着流程走一遍,以便后续按你的需求对生成的参考图进行调整。

-

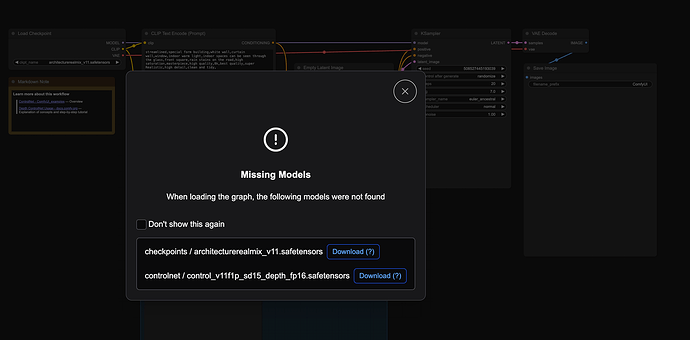

打开工作流时,系统可能会提示缺失模型。如果按照第4步安装了必备模型包和ControlNet模型包的话,此处可无需理会(CheckPoint模型我们会换成自己的底模,ControlNet模型已经包含了深度控制的depth模型,只是模型文件不同,没有识别到)。关掉弹窗提示即可

- 如果缺少其他模型,或者之前没有下载必备模型包和ControlNet模型包的话,也可以在这一步安装缺失的模型

- 如果缺少其他模型,或者之前没有下载必备模型包和ControlNet模型包的话,也可以在这一步安装缺失的模型

-

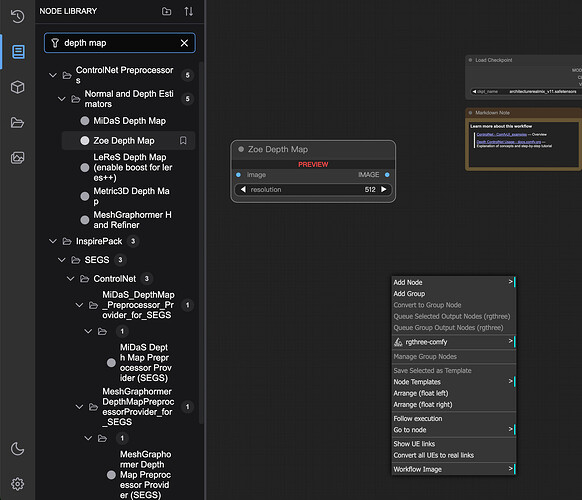

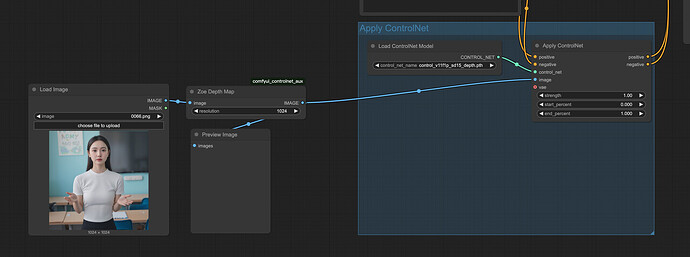

修改默认工作流。官方的默认工作流需要直接上传深度图片,但我们只有一张参考图,所以我们要额外加一个生成深度图片的处理器。

-

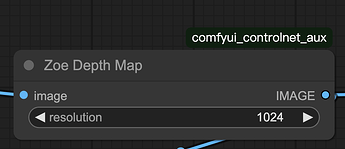

打开右侧Node Library,搜索 depth map。选择

Zoe Depth Map节点添加到视图中

-

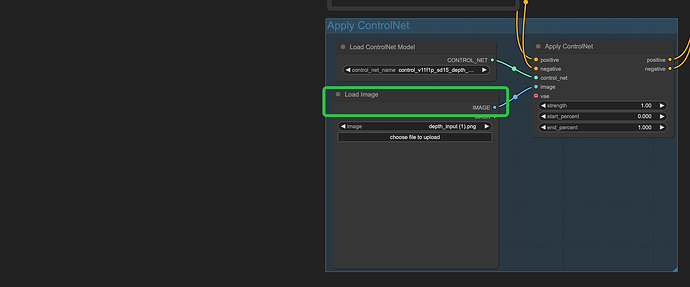

将原工作流中的Load Image节点先连到

Zoe Depth Map节点,然后再连到Apply ControlNet的Image位置。可以加一个Preview Image节点检查下生成的深度图是否正确。

-

修改参数。EchoMimicV2需要的参考图默认是

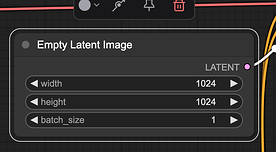

1024x1024的,所以需要修改Zoe Depth Map节点的分辨率为1024,控制最终生成图片分辨率的Empty Latent Image节点也需要设置成1024x1024。

-

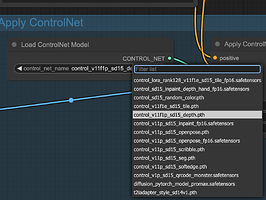

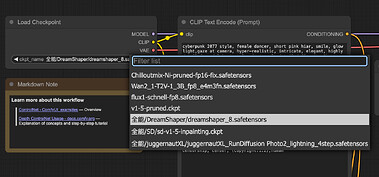

设置模型。ControlNet模型设置一个depth的模型即可,注意需要和你的Checkpoint底模一致,如果是sd1.5的ControlNet就需要选SD1.5的底模,SDXL或Flux的ControlNet同理。Checkpoint模型选择相对写实风的即可,强烈的风格化底模可能导致EchoMimic合成异常,请注意和ControlNet的底模保持一致。

-

-

设置图片提示词。根据你想要的人物形象撰写prompt。如果需要精确控制,这里也可以自行改用图生图的工作流。例如输入以下提示词:

cyberpunk 2077 style, female dancer, short pink hiar, smile, glow light,gaze at camera, hyper-realistic, intricate, elegant, highly detailed, modelshoot style, (extremely detailed CG unity 8k wallpaper), professional majestic oil painting trending on ArtStation, High Detail, Sharp focus, dramatic -

抽卡直至选出自己满意的图片。只要保证人物比例和参考图一致,身前的服饰不要有过于细碎的图案即可。如果发现手指异常,可以不用在意,EchoMimic合成时会用参考手势重绘的。

-

将参考图像上传EchoMimicV2即可使用自己的人物形象进行合成了。

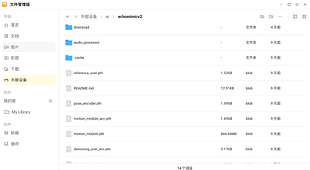

卸载EchoMimicV2

要完全移除EchoMimicV2以及所有相关的模型数据,您需要

- 应用商店卸载 EchoMimicV2

- 删除应用示例数据:进入 文件管理器 > 数据 目录下删除echomimicv2目录。

- 删除模型文件:进入 文件管理器 > 外部设备 > ai > 目录下删除echomimicv2目录。